問いをたてる

AIというのは、本当に理解しているのだろうか? 人間の脳と同じように理解して、数々の問題を解いているのだろうか? その仕組みについて調べてみました。

「言葉が上手い=頭が良い」という思い込みは、私たちの脳が持つ一種の「バグ」に近いかもしれません。

最新のAI、特に大規模言語モデル(LLM)と向き合うとき、私たちはかつてないほどこのバグに直面しています。彼らは驚くほど流暢ですが、その中身を覗くと、私たちが想像する「理解」とは少し違う景色が見えてきます。

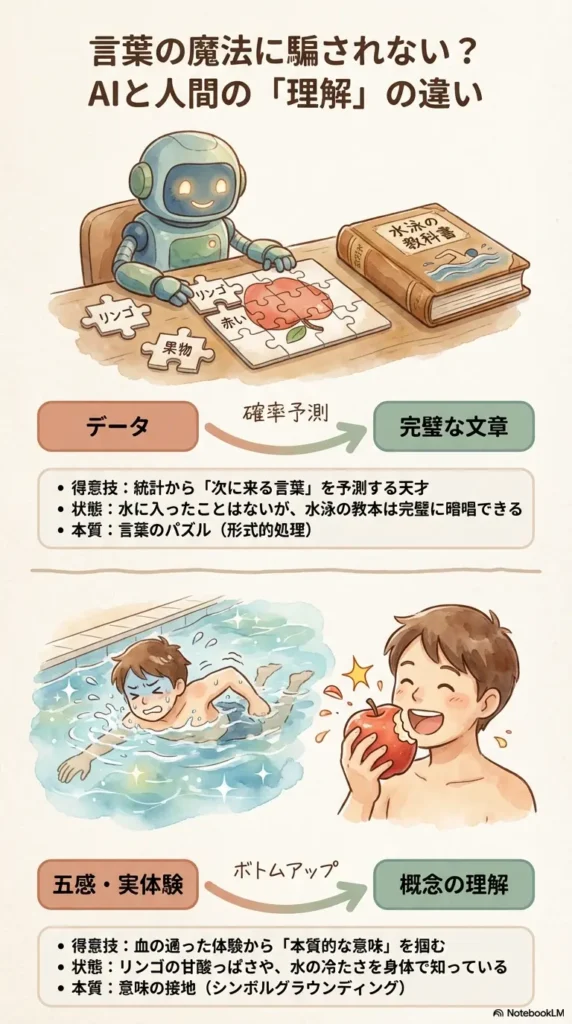

▪️LLMとは、世界中の膨大な情報を読み込んだ**「超・読書家なAI」のことです。 次に続く言葉を確率的に予測してつなげることで、人間のように滑らかな文章を瞬時に作り出します。 いわば、膨大なデータの海から最適な言葉を選び出す「究極の連想ゲーム」の達人**といえる存在です。 この高い表現力が、私たちに「AIが深く理解している」という印象を与えています。

流暢さという名の「魔法」

目の前の相手が立て板に水のごとく理路整然と語り始めたら、私たちは無意識に「この人は物事を深く理解している」と判断してしまいます。これは心理学でいう「ハロー効果(後光効果)」の一種です。

LLMは、膨大なデータの海から「次に来る確率が最も高い言葉」を予測して繋ぎ合わせる天才です。その結果、出力される文章は完璧な文法と洗練された語彙を備えています。しかし、「文法的に正しいこと」と「内容が真実であること(あるいは理解していること)」は、全く別の次元の話なのです。

「統計的予測」と「意味の把握」の決定的な溝

私たちが「リンゴ」という言葉を使うとき、そこには赤い色、甘酸っぱい香り、シャリッとした食感といった「実体験」が紐付いています。これを「意味の接地(シンボルグラウンディング)」と呼びます。

一方で、LLMにとっての「リンゴ」は、あくまで「果物」「赤い」「木になる」といった他の言葉との統計的な関係性に過ぎません。

- 人間: 体験を通して概念を掴む(ボトムアップ)

- LLM: 言葉のパズルを完成させる(形式的処理)

LLMは、いわば「一度も泳いだことがないのに、水泳の教本を完璧に暗唱できる人」のようなものです。言葉の使い方は完璧ですが、水に触れたときの冷たさは知らないのです。

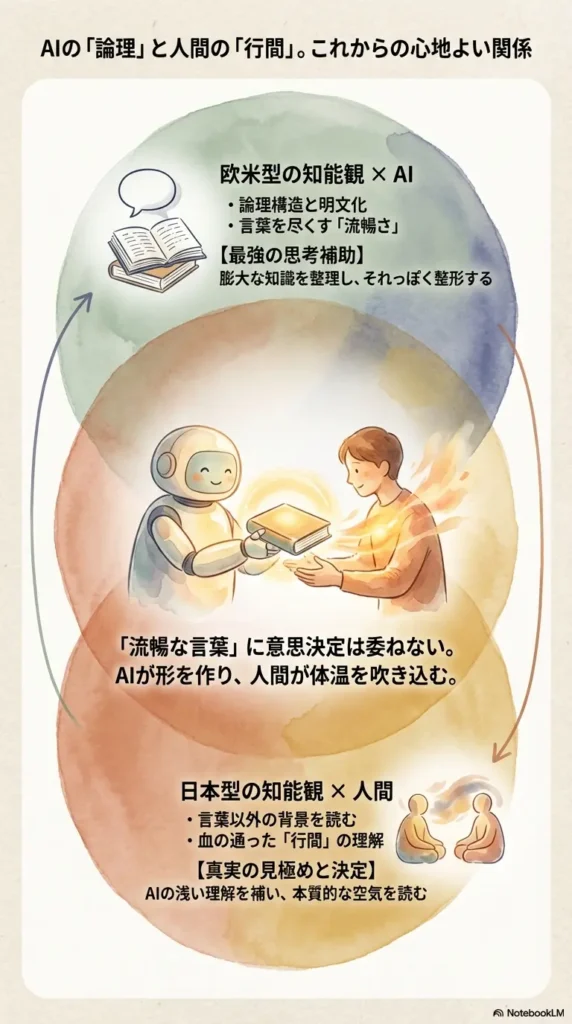

英語圏と日本の「知能観」の違いから見る本質

ここで興味深い比較があります。 欧米(特に英語圏)では、論理構造が明確で、言葉を尽くして説明できることが「知性」の象徴とされる傾向があります(低コンテクスト文化)。そのため、LLMの流暢さはそのまま「知能の高さ」として受け入れられやすい土壌があります。

対して日本は、言葉以外の背景や文脈を読み取る「行間を読む」文化(高コンテクスト文化)です。日本的な感覚からすると、LLMの回答は「理屈は通っているけれど、どこか血が通っていない」「本質的な空気を読めていない」と感じることがあります。

この「違和感」こそが、言語能力(言葉を操る力)と知能(物事の本質を捉え、適応する力)の境界線を言い当てているのです。

私たちが騙されないために

LLMが得意なのは、既存の知識を整理し、それっぽく整形することです。これは「思考の補助」としては最強のツールですが、最終的な「理解」や「意思決定」を委ねるにはリスクがあります。

彼らの「浅い理解」を補い、言葉の裏側にある真実を見極めるのは、依然として血の通った体験を持つ私たちの役割なのです。

私見)確かに流暢に話すを聞くと、理解しているからと結論づけてしまいます。言葉にしていない、暗黙知の部分も言語化されなければ、このままわからないまま進んでしまいますね。現段階でも解説なので、ゆくゆくは変わっていくかもしれません。

最後までお読み頂き、ありがとうございます。

免責事項:本記事は2026年時点のAI技術および認知科学の知見に基づいた解説であり、将来の技術革新によって定義が変化する可能性があります。

コメント