第1回、第2回で、AIは「経験(データ)」から「ヒント(特徴量)」を見つけ出す自習型のシステムだとお伝えしました。では、その自習は「どこで」行われているのでしょうか?

その正体が、AIの心臓部である**「ニューラルネットワーク」**です。

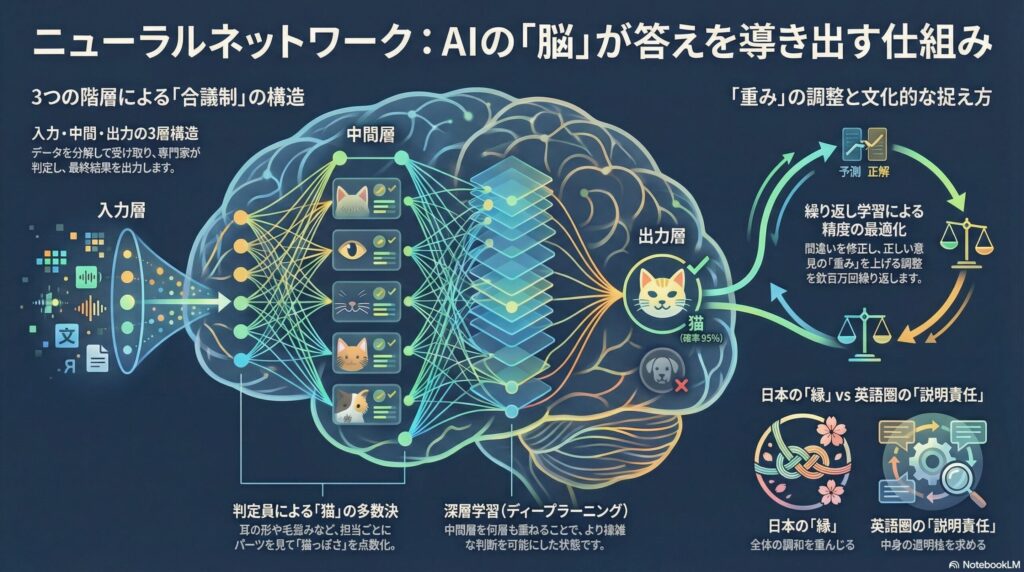

1. 「合議制」で答えを導き出す仕組み

ニューラルネットワークを理解する一番の近道は、**「大勢での多数決」**をイメージすることです。

例えば、ある写真を見て「これは猫か?」を判定するチームを想像してください。このチームは3つの階層に分かれています。

- 入力層(受付): 写真のデジタルデータをバラバラに分解して受け取ります。

- 中間層(専門家集団): ここには何百人もの「判定員」が並んでいます。

- 判定員A:「耳の尖り具合だけをチェックする担当」

- 判定員B:「毛のふわふわ感だけをチェックする担当」

- 判定員C:「目の形だけをチェックする担当」 彼らは自分の担当箇所を見て、「猫っぽい度」を点数化します。

- 出力層(最終判断): 全員の点数を集計し、「95%の確率で猫」という最終結果を出します。

この「判定員同士のつながり」が網の目のようになっているため、ネットワークと呼ばれます。

【イメージ:ニューラルネットワークの構造】

- [入力] ──> [中間層(複雑な網の目)] ──> [出力]

- ※中間層が何層も重なったものが、いわゆる「ディープラーニング(深層学習)」です。

2. 「重み」を調整して賢くなる

最初は、判定員たちは新人なので、デタラメな判定をします。しかし、間違えるたびに「君の意見は今回は無視する(重みを下げる)」「君の意見は正しかった(重みを上げる)」という調整が自動で行われます。

これを何百万回と繰り返すことで、ネットワーク全体の「意見の出し方」が最適化され、驚異的な精度で正解を出せるようになるのです。

3. 日本と英語圏の比較:ニューラルネットワークの捉え方

この複雑なネットワーク構造を、両文化はどう見ているでしょうか。

- 日本の視点: **「縁(えん)」や「つながり」**として捉える感覚があります。個々の計算(判定員)よりも、全体が調和して一つの知能として機能する様子を「有機的なつながり」として肯定的に受け入れます。

- 英語圏の視点: **「ブラックボックス」**としての側面を厳しく注視します。なぜその答えが出たのか?という「説明責任(Explainability)」を重視し、網の目の中の計算をいかに透明化・制御するかという議論が非常に活発です。

「つながりを信じる」日本と、「中身を解明しようとする」英語圏。この両方の視点を持つことが、AIをブラックボックスのままにしないコツです。

第3回の内容は以上です。 次は、いよいよ現代の主役である**「生成AIと大規模言語モデル(LLM)」**へと進みます。

最後までお読み頂き、ありがとうございます。

免責事項 本記事に掲載されている情報は、執筆時点(2026年2月)の技術水準に基づくものです。AI技術は急速に進化しているため、最新の仕様とは異なる場合があります。また、AIの動作原理を分かりやすく説明するために概念を簡略化しており、厳密な数学的定義とは一部異なる箇所があります。

コメント